Запрос: сайт statbet.com, почему не лезет в индекс.

Задачка не тривиальная. Ошибок по SEO действительно много. Главная из них наверное та что не привлекли хоть на консультацию спеца с опытом сеошки больших контентных сайтов.

Хоть ошибок и много, но препятствовать индексации они не должны. Львиная доля станиц у тебе просканирована и была проиндексирована.

А потом в течение месяца большинство выпали из индекса.

Скажи а как контент делали для сайта?

похоже, что так?

Думаю тут и зарыта собака. Большая часть станиц у тебя была изначально проиндексирована.

Часть страниц, типа профилей игроков, выпала как не интересная (мало контента).

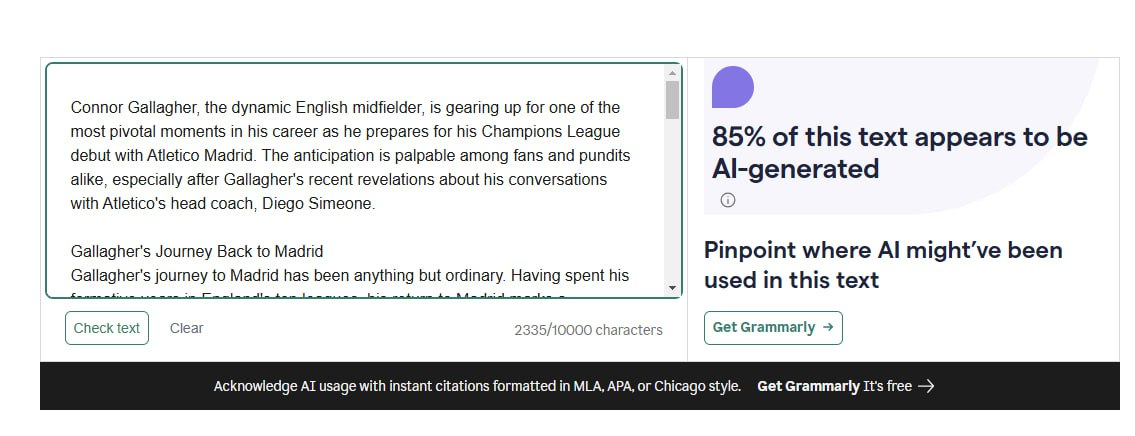

Новости выпали как сгенерированный АИ.

Может там ещё и какой негласный фильтр упал. Но на первый взгляд не видно.

Пока я склоняюсь к этой версии.

Гугл не против использования ИИ но с оговоркой, что контент должен быть уникальным, качественным и интересным юзерам.

Кроме того они прямо говорят если вы будете использовать ИИ для СЕО продвижения мы вас накажем.

Я найду тебе статью где-то была у них

https://developers.google.com/search/blog/2023/02/google-search-and-ai-content?hl=ru

Там в вопросах-ответах еще посмотри. Особенно это касается новостей

Я посмотрел у тебя на большинстве типовых страниц шаблоны с переменными вместо контента. Плюс у тебя наверное шаблоны для мета данных и title дублирует h1

И получается по совокупности факторов тебя задвинули

Н2 заголовков очень мало в основном сразу Н3. Это тоже не хорошо

Итого:

По вопросу с АИ: https://obs.nodeart.app/Projects/STB/author-prompt таким образом предлагается сделать разные интонации и в целом соответствовать EEAT(Experience, Expertise, Authoritativeness, and Trustworthiness) запросу гугла.

Так же возможно попробовать какие-то кардинально отличные модели, вроде яндекса или китайцев для генерации контента (если гугл и детектит какой-то футпринт, то там его не будет)

По вопросам с заголовками и формулами — это все же вопрос к сеошникам. Сейчас все формулы мы уберем, но что-то вместо них нужно предоставить, т.к. сейчас страницы не интересны для гугла (см комментарий выше)

Кроме того найдены еще и другие проблемы — вроде контентных дублей страниц, которые тоже нужно решать. Простое решение — добавить им всем no-index. Можно так делать или нет — хз. Примеры дублей:

- https://statbet.com/football/teams/ru-saint-gilloise/2007-2008/squad

- https://statbet.com/football/teams/ru-saint-gilloise/2020-2021/squad

- https://statbet.com/football/teams/ru-saint-gilloise/2000-2001/squad

Кроме того было найдено еще пара проблем в ahrefs связанных с языками, часть поправлена, часть вроде x-default еще нужно сделать (хотя сеошники и говорили ее убрать, но по-моему они не вникли просто в то, что это такое)